Создание кластера из 2 компьютеров. Настольный кластер. Требования к программному обеспечению

тБВПФБФШ ОБ ПДОПК НБЫЙОЕ ХЦЕ ОЕ НПДОП

ЙМЙ ДЕМБЕН ЛМБУФЕТ Ч ДПНБЫОЙИ ХУМПЧЙСИ.

1. чЧЕДЕОЙЕ

нОПЗЙЕ ЙЪ ЧБУ ЙНЕАФ Ч МПЛБМШОПК УЕФЙ ОЕУЛПМШЛП Linux НБЫЙО, У РТБЛФЙЮЕУЛЙ ЧУЕЗДБ УЧПВПДОЩН РТПГЕУУПТПН. фБЛЦЕ НОПЗЙЕ УМЩЫБМЙ П УЙУФЕНБИ, Ч ЛПФПТЩИ НБЫЙОЩ ПВЯЕДЕОСАФУС Ч ПДЙО УХРЕТЛПНРШАФЕТ. оП ТЕБМШОП НБМП ЛФП РТПВПЧБМ РТПЧПДЙФШ ФБЛЙЕ ЬЛУРЕТЙНЕОФЩ Х УЕВС ОБ ТБВПФЕ ЙМЙ ДПНБ. дБЧБКФЕ РПРТПВХЕН ЧНЕУФЕ УПВТБФШ ОЕВПМШЫПК ЛМБУФЕТ. рПУФТПЙЧ ЛМБУФЕТ ЧЩ УНПЦЕФЕ ТЕБМШОП ХУЛПТЙФШ ЧЩРПМОЕОЙЕ ЮБУФЙ ЪБДБЮ. оБРТЙНЕТ ЛПНРЙМСГЙА ЙМЙ ПДОПЧТЕНЕООХА ТБВПФХ ОЕУЛПМШЛЙИ ТЕУХТУПЕНЛЙИ РТПГЕУУПЧ. ч ЬФПК УФБФШЕ С РПУФБТБАУШ ТБУУЛБЪБФШ ЧБН ЛБЛ НПЦОП ВЕЪ ПУПВЩИ ХУЙМЙК ПВЯЕДЕОЙФШ НБЫЙОЩ УЧПЕК МПЛБМШОПК УЕФЙ Ч ЕДЙОЩК ЛМБУФЕТ ОБ ВБЪЕ MOSIX.2. лБЛ,ЮФП Й ЗДЕ.

MOSIX - ЬФП РБФЮ ДМС СДТБ Linux У ЛПНРМЕЛФПН ХФЙМЙФ, ЛПФПТЩК РПЪЧПМСЕФ РТПГЕУУБН У ЧБЫЕК НБЫЙОЩ РЕТЕИПДЙФШ (НЙЗТЙТПЧБФШ) ОБ ДТХЗЙЕ ХЪМЩ МПЛБМШОПК УЕФЙ. чЪСФШ ЕЗП НПЦОП РП БДТЕУХ HTTP://www.mosix.cs.huji.ac.il Б ТБУРТПУФТБОСЕФУС ПО Ч ЙУИПДОЩИ ЛПДБИ РПД МЙГЕОЪЙЕК GPL. рБФЮЙ УХЭЕУФЧХАФ ДМС ЧУЕИ СДЕТ ЙЪ УФБВЙМШОПК ЧЕФЛЙ Linux.3. хУФБОПЧЛБ РТПЗТБННОПЗП ПВЕУРЕЮЕОЙС.

ч ОБЮБМЕ ХУФБОПЧЛЙ ИПЮХ РПТЕЛПНЕОДПЧБФШ ЧБН ЪБВЙТБФШ У ХЪМБ MOSIX ОЕ ФПМШЛП ЕЗП, ОП Й УПРХФУФЧХАЭЙЕ ХФЙМЙФЩ - mproc, mexec Й ДТ.ч БТИЙЧЕ MOSIX ЕУФШ ХУФБОПЧПЮОЩК УЛТЙРФ mosix_install. оЕ ЪБВХДШФЕ Ч ПВСЪБФЕМШОПН РПТСДЛЕ ТБУРБЛПЧБФШ ЙУИПДОЩЕ ЛПДЩ СДТБ Ч /usr/src/linux-*.*.*, ОБРТЙНЕТ ЛБЛ УДЕМБМ С - Ч /usr/src/linux-2.2.13 ДБМЕЕ ЪБРХУЛБЕФЕ mosix_install Й ПФЧЕЮБЕФЕ ОБ ЧУЕ ЕЗП ЧПРТПУЩ, ХЛБЪБЧ ЕНХ УЧПК НЕОЕДЦЕТ ЪБЗТХЪЛЙ (LILO), РХФШ Л ЙУИПДОЙЛБН СДТБ Й ХТПЧОЙ ЪБРХУЛБ.

рТЙ ОБУФТПКЛЕ СДТБ ЧЛМАЮЙФЕ ПРГЙЙ CONFIG_MOSIX, CONFIG_BINFMT_ELF Й CONFIG_PROC_FS. чУЕ ЬФЙ ПРГЙЙ РПДТПВОП ПРЙУБОЩ Ч ТХЛПЧПДУФЧЕ РП ХУФБОПЧЛЕ MOSIX.

хУФБОПЧЙМЙ? оХ ЮФП ЦЕ - РЕТЕЗТХЦБКФЕ ЧБЫ Linux У ОПЧЩН СДТПН, ОБЪЧБОЙЕ ЛПФПТПЗП ПЮЕОШ ВХДЕФ РПИПЦЕ ОБ mosix-2.2.13.

4. оБУФТПКЛБ

йЪОБЮБМШОП ХУФБОПЧМЕООЩК MOSIX УПЧЕТЫЕООП ОЕ ЪОБЕФ, ЛБЛЙЕ Х ЧБУ НБЫЙОЩ Ч УЕФЙ Й У ЛЕН ЕНХ УПЕДЕОСФУС. оХ Б ОБУФТБЙЧБЕФУС ЬФП ПЮЕОШ РТПУФП. еУМЙ ЧЩ ФПМШЛП РПУФБЧЙМЙ mosix Й ЕУМЙ ЧБЫ ДЙУФТЙВХФЙЧ - SuSE ЙМЙ RedHat - УПЧНЕУФЙНЩК, ФП ЪБИПДЙФЕ Ч ЛБФБМПЗ /etc/rc.d/init.d Й ДБЧБКФЕ ЛПНБОДХ mosix start. рТЙ РЕТЧПН ЪБРХУЛЕ ЬФПФ УЛТЙРФ РТПУЙФ ЧБУ ОБУФТПЙФШ MOSIX Й ЪБРХУЛБЕФ ФЕЛУФПЧЩК ТЕДБЛФПТ ДМС УПЪДБОЙС ЖБКМБ /etc/mosix.map, Ч ЛПФПТПН ОБИПДЙФУС УРЙУПЛ ХЪМПЧ ЧБЫЕЗП ЛМБУФЕТБ. фХДБ РТПРЙУЩЧБЕН: Ч УМХЮБЕ, ЕУМЙ Х ЧБУ ЧУЕЗП ДЧЕ-ФТЙ НБЫЙОЩ Й ЙИ IP-БДТЕУБ УМЕДХАФДТХЗ ЪБ ДТХЗПН РП ОПНЕТБГЙЙ РЙЫЕН ФБЛ:

1 10.152.1.1

5

зДЕ РЕТЧЩК РБТБНЕФТ ПВПЪОБЮБЕФ ОПНЕТ ОБЮБМШОПЗП ХЪМБ, ЧФПТПК

- IP БДТЕУ РЕТЧПЗП ХЪМБ Й РПУМЕДОЙК - ЛПМЙЮЕУФЧП ХЪМПЧ У ФЕЛХЭЕЗП. ф.Е.

УЕКЮБУ Х ОБУ Ч ЛМБУФЕТЕ ПМХЮБЕФУС РСФШ ХЪМПЧ, IP БДТЕУБ ЛПФПТЩК ЪБЛБОЮЙЧБАФУС

ОБ 1, 2, 3, 4 Й 5.

йМЙ ДТХЗПК РТЙНЕТ:

оПНЕТ ХЪМБ IP

ЛПМЙЮЕУФЧП ХЪМПЧ У ФЕЛХЭЕЗП

______________________________________

1 10.152.1.1

1

2 10.150.1.55

2

4 10.150.1.223

1

ч ЬФПК ЛПОЖЙЗХТБГЙЙ НЩ РПМХЮЙН УМЕДХАЭЙК ТБУЛМБД:

IP 1-ПЗП ХЪМБ 10.150.1.1

IP 2-ПЗП ХЪМБ 10.150.1.55

IP 3-ПЗП ХЪМБ 10.150.1.56

IP 4-ПЗП ХЪМБ 10.150.1.223

фЕРЕТШ ОХЦОП ОБ ЧУЕИ НБЫЙОБИ ВХДХЭЕЗП ЛМБУФЕТБ ХУФБОПЧЙФШ MOSIX Й УПЪДБФШ

ЧЕЪДЕ ПДЙОБЛПЧЩК ЛПОЖЙЗХТБГЙПООЩК ЖБКМ /etc/mosix.map .

фЕРЕТШ РПУМЕ РЕТЕЪБРХУЛБ mosix ЧБЫБ НБЫЙОБ ХЦЕ ВХДЕФ ТБВПФБФШ Ч ЛМБУФЕТЕ,

ЮФП НПЦОП ХЧЙДЕФШ ЪБРХУФЙЧ НПОЙФПТ ЛПНБОДПК mon. ч УМХЮБЕ, ЕУМЙ ЧЩ ХЧЙДЙФЕ

Ч НПОЙФПТЕ ФПМШЛП УЧПА НБЫЙОХ ЙМЙ ЧППВЭЕ ОЕ ХЧЙДЙФЕ ОЙЛПЗП, ФП, ЛБЛ ЗПЧПТЙФУС

- ОБДП ТЩФШ. уЛПТЕЕ ЧУЕЗП Х ЧБУ ПЫЙВЛБ ЙНЕООП Ч /etc/mosix.map.

оХ ЧПФ, ХЧЙДЙМЙ, ОП ОЕ РПВЕДЙМЙ. юФП ДБМШЫЕ? б ДБМШЫЕ

ПЮЕОШ РТПУФП:-) - ОХЦОП УПВТБФШ ХФЙМЙФЩ ДМС ТБВПФЩ У ЙЪНЕОЕООЩН

/proc ЙЪ РБЛЕФБ mproc. ч ЮБУФОПУФЙ Ч ЬФПН РБЛЕФЕ ЙДЕФ ОЕРМПИБС НПДЙЖЙЛБГЙС

top - mtop, Ч ЛПФПТЩК ДПВБЧЙМЙ ЧПЪНПЦОПУФШ ПФПВТБЦЕОЙС ХЪМБ(node),

УПТФЙТПЧЛЙ РП ХЪМБН, РЕТЕОПУБ РТПГЕУУБ У ФЕЛХЭЕЗП ХЪМБ ОБ ДТХЗПК Й ХУФБОПЧМЕОЙС

НЙОЙНБМШОПК ЪБЗТХЪЛЙ РТПГЕУУПТБ ХЪМБ, РПУМЕ ЛПФПТПК РТПГЕУУЩ ОБЮЙОБАФ НЙЗТЙТПЧБФШ

ОБ ДТХЗЙЕ MOSIX - ХЪМЩ.

ъБРХУЛБЕН mtop, ЧЩВЙТБЕН РПОТБЧЙЧЫЙКУС ОЕ УРСЭЙК

РТПГЕУУ (ТЕЛПНЕОДХА ЪБРХУФЙФШ bzip) Й УНЕМП ДБЧЙН ЛМБЧЙЫХ "g" ОБ ЧБЫЕК

ЛМБЧЙБФХТЕ, РПУМЕ ЮЕЗП ЧЧПДЙН ОБ ЪБРТПУ PID ЧЩВТБООПЗП Ч ЛБЮЕУФЧЕ ЦЕТФЧЩ

РТПГЕУУБ Й ЪБФЕН - ОПНЕТ ХЪМБ, ЛХДБ НЩ ИПФЙН ЕЗП ПФРТБЧЙФШ. б ХЦЕ РПУМЕ

ЬФПЗП ЧОЙНБФЕМШОП РПУНПФТЙФЕ ОБ ТЕЪХМШФБФЩ, ПФПВТБЦБЕНЩЕ ЛПНБОДПК mon -

ФБ НБЫЙОБ ДПМЦОБ ОБЮБФШ ВТБФШ ОБ УЕВС ОБЗТХЪЛХ ЧЩВТБООПЗП РТПГЕУУБ.

б УПВУФЧЕООП mtop - Ч РПМЕ #N ПФПВТБЦБФШ ОПНЕТ ХЪМБ,

ЗДЕ ПО ЧЩРПМОСЕФУС.

оП ЬФП ЕЭЕ ОЕ ЧУЕ - ЧЕДШ ЧБН РТБЧДБ ОЕ ИПЮЕФУС ПФРТБЧМСФШ ОБ ДТХЗЙЕ

ХЪМЩ РТПГЕУУЩ ЧТХЮОХА? нОЕ ОЕ ЪБИПФЕМПУШ. х MOSIX ЕУФШ ОЕРМПИБС ЧУФТПЕООБС

ВБМБОУЙТПЧЛБ ЧОХФТЙ ЛМБУФЕТБ, ЛПФПТБС РПЪЧПМСЕФ ВПМЕЕ-НЕОЕЕ ТБЧОПНЕТОП

ТБУРТЕДЕМСФШ ОБЗТХЪЛХ ОБ ЧУЕ ХЪМЩ. оХ Б ЧПФ ЪДЕУШ ОБН РТЙДЕФУС РПФТХДЙФУС.

дМС ОБЮБМБ С ТБУУЛБЦХ, ЛБЛ УДЕМБФШ ФПОЛХА ОБУФТПКЛХ (tune) ДМС ДЧХИ ХЪМПЧ

ЛМБУФЕТБ? Ч РТПГЕУУЕ ЛПФПТПК MOSIX РПМХЮБЕФ ЙОЖПТНБГЙА П УЛПТПУФСИ РТПГЕУУПТПЧ

Й УЕФЙ:

ъБРПНОЙФЕ ТБЪ Й ОБЧУЕЗДБ - tune НПЦОП ЧЩРПМОСФШ

ФПМШЛП Ч single-mode. йОБЮЕ ЧЩ МЙВП РПМХЮЙФЕ ОЕ УПЧУЕН ЛПТТЕЛФОЩК ТЕЪХМШФБФ,

МЙВП ЧБЫБ НБЫЙОБ НПЦЕФ РТПУФП ЪБЧЙУОХФШ.

йФБЛ, ЧЩРПМОСЕН tune. рПУМЕ РЕТЕЧПДБ ПРЕТБГЙПООПК УЙУФЕНЩ Ч single

- mode ОБРТЙНЕТ ЛПНБОДПК init 1 ЙМЙ init S ЪБРХУЛБЕН УЛТЙРФ prep_tune,

ЛПФПТЩК РПДОЙНЕФ cЕФЕЧЩЕ

ЙОФЕТЖЕКУЩ Й ЪБРХУФЙФ MOSIX. рПУМЕ ЬФПЗП ОБ ПДОПК ЙЪ НБЫЙО ЪБРХУЛБЕН

tune, ЧЧПДЙН ЕНХ ОПНЕТ ДТХЗПЗП ХЪМБ ДМС ОБУФТПКЛЙ Й ЦДЕН ТЕЪХМШФБФБ - ХФЙМЙФБ

ДПМЦОБ ЧЩДБФШ ЪБРТПУ ОБ ЧЧПД ЫЕУФЙ ЮЙУЕМ, РПМХЮЕООЩИ ПФ ЧЩРПМОЕОЙС ЛПНБОДЩ

tune -a <ХЪЕМ> ОБ ДТХЗПН ХЪМЕ. уПВУФЧЕООП ПРЕТБГЙА РТЙДЕФУС РПЧФПТЙФШ

ОБ ДТХЗПН ХЪМЕ ЛПНБОДПК tune -a <ХЪЕМ>, Б ТЕЪХМШФБФ ЙЪ ЫЕУФЙ ЮЙУЕМ ЧЧЕУФЙ

ОБ РЕТЧЩК ХЪЕМ. рПУМЕ РПДПВОПЗП ФАОЙОЗБ Ч ЧБЫЕК УЙУФЕНЕ ДПМЦЕО РПСЧЙФУС

ЖБКМ /etc/overheads, УПДЕТЦБЭЙК ЙОЖПТНБГЙА ДМС MOSIX Ч ЧЙДЕ ОЕЛЙИ ЮЙУМПЧЩИ

ДБООЩИ. ч УМХЮБЕ, ЕУМЙ РП ЛБЛЙН-ФП РТЙЮЙОБН tune ОЕ УНПЗ УДЕМБФШ ЕЗП, РТПУФП

УЛПРЙТХКФЕ ЙЪ ФЕЛХЭЕЗП ЛБФБМПЗБ ЖБКМ mosix.cost Ч /etc/overheads. ьФП РПНПЦЕФ;-).

рТЙ ФАОЙОЗЕ ЛМБУФЕТБ ЙЪ ВПМЕЕ ЮЕН ДЧХИ НБЫЙО ОХЦОП

ЙУРПМШЪПЧБФШ ХФЙМЙФХ, ЛПФПТБС ФБЛЦЕ РПУФБЧМСЕФУС У MOSIX - tune_kernel.

дБООБС ХФЙМЙФБ РПЪЧПМСЕФ

ЧБН Ч ВПМЕЕ РТПУФПН Й РТЙЧЩЮОПН ЧЙДЕ ОБУФТПЙФШ ЛМБУФЕТ, ПФЧЕФЙЧ ОБ

ОЕУЛПМШЛП ЧПРТПУПЧ Й РТПЧЕДС ФАОЙОЗ У ДЧХНС НБЫЙОБНЙ ЛМБУФЕТБ.

лУФБФЙ, РП УПВУФЧЕООПНХ ПРЩФХ НПЗХ УЛБЪБФШ, ЮФП

РТЙ ОБУФТПКЛЕ ЛМБУФЕТБ С ТЕЛПНЕОДХА ЧБН ОЕ ЪБЗТХЦБФШ УЕФШ, Б ОБПВПТПФ -

РТЙПУФБОПЧЙФШ ЧУЕ БЛФЙЧОЩЕ ПРЕТБГЙЙ Ч МПЛБМШОПК УЕФЙ.

5. хРТБЧМЕОЙЕ ЛМБУФЕТПН

дМС ХРТБЧМЕОЙС ХЪМПН ЛМБУФЕТБ УХЭЕУФЧХЕФ ОЕВПМШЫПК ОБВПТ ЛПНБОД, УТЕДЙ ЛПФПТЩИ:mosctl

- ЛПОФТПМШ ОБД ХЪМПН. рПЪЧПМСЕФ ЙЪНЕОСФШ РБТБНЕФТЩ

ХЪМБ - ФБЛЙЕ, ЛБЛ block, stay, lstay, delay Й Ф.Д

дБЧБКФЕ ТБУУНПФТЙН ОЕУЛПМШЛП РБТБНЕФТПЧ ЬФПК ХФЙМЙФЩ:

stay

- РПЪЧПМСЕФ ПУФБОБЧМЙЧБФШ НЙЗТБГЙА РТПГЕУУПЧ ОБ

ДТХЗЙЕ ХЪМЩ У ФЕЛХЭЕК НБЫЙОЩ. пФНЕОСЕФУС РБТБНЕФТПН nostay ЙМЙ -stay

lstay

- ЪБРТЕЭБЕФ ФПМШЛП МПЛБМШОЩН РТПГЕУУБН НЙЗТБГЙА,

Б РТПГЕУУЩ У ДТХЗЙИ НБЫЙО НПЗХФ РТПДПМЦБФШ ЬФП ДЕМБФШ. пФНЕОСЕФУС РБТБНЕФТПН

nolstay ЙМЙ -lstay.

block

- ЪБРТЕЭБЕФ ХДБМЕООЩН/ЗПУФЕЧЩН РТПГЕУУБН ЧЩРПМОСФУС

ОБ ЬФПН ХЪМЕ. пФНЕОСЕФУС РБТБНЕФТПН noblock ЙМЙ -block.

bring

- ЧПЪЧТБЭБЕФ ПВТБФОП ЧУЕ РТПГЕУУЩ У ФЕЛХЭЕЗП ХЪМБ

ЧЩРПМОСЕНЩЕ ОБ ДТХЗЙИ НБЫЙОБИ ЛМБУФЕТБ. ьФПФ РБТБНЕФТ НПЦЕФ ОЕ УТБВБФЩЧБФШ,

РПЛБ НЙЗТЙТПЧБЧЫЙК РТПГЕУУ ОЕ РПМХЮЙФ РТЕТЩЧБОЙЕ ПФ УЙУФЕНЩ.

setdelay

ХУФБОБЧМЙЧБЕФ ЧТЕНС, РПУМЕ ЛПФПТПЗП РТПГЕУУ

ОБЮЙОБЕФ НЙЗТЙТПЧБФШ.

чЕДШ УПЗМБУЙФЕУШ - Ч УМХЮБЕ, ЕУМЙ ЧТЕНС ЧЩРПМОЕОЙС РТПГЕУУБ НЕОШЫЕ

УЕЛХОДЩ УНЩУМ РЕТЕОПУЙФШ ЕЗП ОБ ДТХЗЙЕ НБЫЙОЩ УЕФЙ ЙУЮЕЪБЕФ. йНЕООП ЬФП

ЧТЕНС Й ЧЩУФБЧМСЕФУС ХФЙМЙФПК mosctl У РБТБНЕФТПН setdecay. рТЙНЕТ:

mosctl setdecay 1 500 200

ХУФБОБЧМЙЧБЕФ ЧТЕНС РЕТЕИПДБ ОБ ДТХЗЙЕ ХЪМЩ 500 НЙММЙУЕЛХОД Ч УМХЮБЕ,

ЕУМЙ РТПГЕУУ ЪБРХЭЕО ЛБЛ slow Й 200 НЙМЙУЕЛХОД ДМС fast РТПГЕУУПЧ. пВТБФЙФЕ

ЧОЙНБОЙЕ, ЮФП РБТБНЕФТ slow ЧУЕЗДБ ДПМЦЕО ВЩФШ ВПМШЫЕ ЙМЙ ТБЧЕО РБТБНЕФТХ

fast.

mosrun

- ЪБРХУЛБЕФ РТЙМПЦЕОЙЕ Ч ЛМБУФЕТЕ. ОБРТЙНЕТ mosrun

-e -j5 make ЪБРХУФЙФ make ОБ 5-ПН ХЪМЕ ЛМБУФЕТБ, РТЙ ЬФПН ЧУЕ ЕЗП ДПЮЕТОЙЕ

РТПГЕУУЩ ВХДХФ ФБЛЦЕ ЧЩРПМОСФУС ОБ 5-ПН ХЪМЕ. рТБЧДБ ЪДЕУШ ЕУФШ ПДЙО ОАБОУ,

РТЙ ЮЕН ДПЧПМШОП УХЭЕУФЧЕООЩК:

Ч УМХЮБЕ, ЕУМЙ ДПЮЕТОЙЕ РТПГЕУУЩ ЧЩРПМОСАФУС ВЩУФТЕЕ ЮЕН ХУФБОПЧМЕООБС

ХФЙМЙФПК mosctl ЪБДЕТЦЛБ (delay) ФП РТПГЕУУ ОЕ ВХДЕФ НЙЗТЙТПЧБФШ ОБ ДТХЗЙЕ

ХЪМЩ ЛМБУФЕТБ. Х mosrun ЕЭЕ ДПЧПМШОП НОПЗП ТБЪМЙЮОЩИ ЙОФЕТЕУОЩИ РБТБНЕФТПЧ,

ОП РПДТПВОП ХЪОБФШ

П ОЙИ ЧЩ УНПЦЕФЕ ЙЪ ТХЛПЧПДУФЧБ РП ЬФПК ХФЙМЙФЕ. (man mosrun)

mon - ЛБЛ НЩ ХЦЕ ЪОБЕН, ЬФП НПОЙФПТ ЛМБУФЕТБ, ЛПФПТЩК Ч РУЕЧДПЗТБЖЙЮЕУЛПН ЧЙДЕ ПФПВТБЦБЕФ ЪБЗТХЪЛХ ЛБЦДПЗП ТБВПЮЕЗП ХЪМБ ЧБЫЕЗП ЛМБУФЕТБ, ЛПМЙЮЕУФЧП УЧПВПДОПК Й ЪБОСФПК РБНСФЙ ХЪМПЧ Й ЧЩДБЕФ НОПЗП ДТХЗПК, ОЕ НЕОЕЕ ЙОФЕТЕУОПК ЙОЖПТНБГЙЙ.

mtop - НПДЙЖЙГЙТПЧБООБС ДМС ЙУРПМШЪПЧБОЙС ОБ ХЪМБИ ЛМБУФЕТБ ЧЕТУЙС ЛПНБОДЩ top. пФПВТБЦБЕФ ОБ ЬЛТБОЕ ДЙОБНЙЮЕУЛХА ЙОЖПТНБГЙА П РТПГЕУУБИ, ЪБРХЭЕООЩИ ОБ ДБООПН ХЪМЕ, Й ХЪМБИ, ЛХДБ НЙЗТЙТПЧБМЙ ЧБЫЙ РТПГЕУУЩ.

mps - ФПЦЕ НПДЙЖЙГЙТПЧБООБС ЧЕТУЙС ЛПНБОДЩ ps. дПВБЧМЕОП ЕЭЕ ПДОП РПМЕ - ОПНЕТ ХЪМБ, ОБ ЛПФПТЩК НЙЗТЙТПЧБМ РТПГЕУУ.

чПФ ОБ НПК ЧЪЗМСД Й ЧУЕ ПУОПЧОЩЕ ХФЙМЙФЩ. оБ УБНПН ДЕМЕ ЛПОЕЫОП НПЦОП

ПВПКФЙУШ ДБЦЕ ВЕЪ ОЙИ. оБРТЙНЕТ ЙУРПМШЪХС ДМС ЛПОФТПМС ОБД ЛМБУФЕТПН /proc/mosix.

фБН ЛТПНЕ ФПЗП, ЮФП НПЦОП ОБКФЙ ПУОПЧОХА ЙОЖПТНБГЙА П ОБУФТПКЛБИ ХЪМБ,

РТПГЕУУБИ ЪБРХЭЕООЩИ У ДТХЗЙИ ХЪМПЧ Й Ф.Д.,Б ФБЛЦЕ РПНЕОСФШ ЮБУФШ РБТБНЕФТПЧ.

6. ьЛУРЕТЕНЕОФЙТХЕН.

л УПЦБМЕОЙА, НОЕ ОЕ ХДБМПУШ ЪБУФБЧЙФШ ЧЩРПМОСФУС ЛБЛПК-ФП ПДЙО РТПГЕУУ ПДОПЧТЕНЕООП ОБ ОЕУЛПМШЛЙИ ХЪМБИ. нБЛУЙНХН, ЮЕЗП С ДПУФЙЗ Ч РТПГЕУУЕ ЬЛУРЕТЙНЕОФПЧ У ЛМБУФЕТПН-ЙУРПМШЪПЧБОЙЕ ДМС ЧЩРПМОЕОЙС ТЕУХТУПЕНЛЙИ РТПГЕУУПЧ ОБ ДТХЗПН ХЪМЕ.дБЧБКФЕ ТБУУНПФТЙН ПДЙО ЙЪ РТЙНЕТПЧ:

дПРХУФЙН, ЮФП Х ОБУ Ч ЛМБУФЕТЕ ТБВПФБАФ ДЧЕ НБЫЙОЩ (ДЧБ ХЪМБ), ПДЙО ЙЪ ЛПФПТЩИ У ОПНЕТПН 1 (366 Celeron), ДТХЗПК - У ОПНЕТПН 5(PIII450). ьЛУРЕТЙНЕОФЙТПЧБФШ НЩ ВХДЕН ОБ 5-ПН ХЪМЕ. 1-К ХЪЕМ Ч ЬФП ЧТЕНС РТПУФБЙЧБМ. ;-)

йФБЛ, ЪБРХУЛБЕН ОБ 5-Н ХЪМЕ ХФЙМЙФХ crark ДМС РПДВПТБ РБТПМС Л rar БТИЙЧХ.еУМЙ ЛФП ЙЪ ЧБУ РТПВПЧБМ ТБВПФБФШ У РПДПВОЩНЙ ХФЙМЙФБНЙ, ФП ПО ДПМЦЕО ЪОБФШ, ЮФП РТПГЕУУ РПДВПТБ РБТПМС "ЛХЫБЕФ" ДП 99 РТПГЕОФПЧ РТПГЕУУПТБ. оХ ЮФП ЦЕ - РПУМЕ ЪБРХУЛБ НЩ ОБВМАДБЕН, ЮФП РТПГЕУУ ПУФБЕФУС ОБ ЬФПН, 5-ПН ХЪМЕ. тБЪХНОП - ЧЕДШ ЙНЕООП Х ЬФПЗП ХЪМБ РТПЙЪЧПДЙФЕМШОПУФШ РТЕЧЩЫБЕФ 1-К ХЪЕМ РПЮФЙ Ч ДЧБ ТБЪБ.

дБМЕЕ НЩ РТПУФП ЪБРХУФЙМЙ УВПТЛХ kde 2.0. уНПФТЙН ФБВМЙГХ РТПГЕУУПЧ Й ЧЙДЙН, ЮФП crark ХУРЕЫОП НЙЗТЙТПЧБМ ОБ 1-К ХЪЕМ, ПУЧПВПДЙЧ РТПГЕУУПТ Й РБНСФШ (ДБ, ДБ - РБНСФШ ФПЮОП ФБЛЦЕ ПУЧПВПЦДБЕФУС) ДМС make. б ЛБЛ ФПМШЛП make ЪБЛПОЮЙМ УЧПА ТБВПФХ - crark ЧЕТОХМУС ПВТБФОП, ОБ ТПДОПК ЕНХ 5-К ХЪЕМ.

йОФЕТЕУОЩК ЬЖЖЕЛФ РПМХЮБЕФУС, ЕУМЙ crark ЪБРХУЛБФШ ОБ ВПМЕЕ НЕДМЕООПН 1-Н ХЪМЕ.

фБН НЩ ОБВМАДБЕН РТБЛФЙЮЕУЛЙ РТПФЙЧПРПМПЦОЩК ТЕЪХМШФБФ - РТПГЕУУ УТБЪХ-ЦЕ НЙЗТЙТХЕФ ОБ 5-К, ВПМЕЕ ВЩУФТЩК ХЪЕМ. рТЙ ЬФПН ПО ЧПЪЧТБЭБЕФУС ПВТБФОП, ЛПЗДБ ИПЪСЙО РСФПЗП ЛПНРШАФЕТБ ОБЮЙОБЕФ ЛБЛЙЕ-ФП ДЕКУФЧЙС У УЙУФЕНПК.

7. йУРПМШЪПЧБОЙЕ

дБЧБКФЕ Ч ЛПОГЕ ТБЪВЕТЕНУС, ЪБЮЕН Й ЛБЛ НЩ НПЦЕН ЙУРПМШЪПЧБФШ ЛМБУФЕТ Ч УЧПЕК РПЧУЕДОЕЧОПК ЦЙЪОЙ.дМС ОБЮБМБ ОХЦОП ТБЪ Й ОБЧУЕЗДБ ЪБРПНОЙФШ - ЛМБУФЕТ ЧЩЗПДЕО ФПМШЛП Ч ФПН УМХЮБЕ, ЛПЗДБ Ч ЧБЫЕК УЕФЙ ЕУФШ ЬООПЕ ЛПМЙЮЕУФЧП НБЫЙО, ЛПФПТЩЕ ЮБУФЕОШЛП РТПУФБЙЧБАФ Й ЧЩ ИПФЙФЕ ЙУРПМШЪПЧБФШ ЙИ ТЕУХТУЩ ОБРТЙНЕТ ДМС УВПТЛЙ KDE ЙМЙ ДМС МАВЩИ УЕТШЕЪОЩИ РТПГЕУУПЧ. чЕДШ ВМБЗПДБТС ЛМБУФЕТХ ЙЪ 10 НБЫЙО НПЦОП ПДОПЧТЕНЕООП

ЛПНРЙМЙТПЧБФШ ДП 10 ФСЦЕМЩИ РТПЗТБНН ОБ ФПН-ЦЕ C++. йМЙ РПДВЙТБФШ ЛБЛПК-ФП РБТПМШ,

ОЕ РТЕЛТБЭБС ОЙ ОБ УЕЛХОДХ ЬФПЗП РТПГЕУУБ ОЕЪБЧЙУЙНП ПФ ОБЗТХЪЛЙ ОБ ЧБЫ ЛПНРШАФЕТ.

дБ Й ЧППВЭЕ - ЬФП РТПУФП ЙОФЕТЕУОП;-).

8. ъБЛМАЮЕОЙЕ

ч ЪБЛМАЮЕОЙЕ ИПЮХ УЛБЪБФШ, ЮФП Ч ЬФПК УФБФШЕ ОЕ ТБУУНПФТЕОЩ ЧУЕ ЧПЪНПЦОПУФЙ MOSIX, Ф.Л. С РТПУФП ДП ОЙИ ЕЭЕ ОЕ ДПВТБМУС. еУМЙ ДПВЕТХУШ - ЦДЙФЕ РТПДПМЦЕОЙС. :-)В первую очередь определитесь с тем, какие компоненты и ресурсы потребуются. Вам нужен будет один главный узел, минимум десяток идентичных вычислительных узлов, свитч Ethernet, блок распределения питания и стойка. Определите мощность проводки и охлаждения, а также площадь пространства, которые вам потребуются. Также определитесь, какие IP адреса вы хотите использовать для узлов, какое ПО вы поставите и какие технологии потребуются для создания параллельных вычислительных мощностей (подробнее об этом ниже).

- Хотя «железо» стоит дорого, все приведенные в статье программы распространяются бесплатно, и большинство из них - с открытым исходным кодом.

- Если вы хотите узнать, насколько быстрым теоретически может быть ваш суперкомпьютер, используйте этот инструмент:

Смонтируйте ноды. Вам нужно будет собрать узлы сети или приобрести предварительно собранные серверы.

- Выбирайте рамы для серверов с максимально рациональным использованием пространства и энергии, а также с эффективным охлаждением.

- Или вы можете «утилизировать» десяток или около того б/у серверов, несколько устаревших - и пусть их вес превышает суммарный вес комплектующих, зато вы сэкономите приличную сумму. Все процессоры, сетевые адаптеры и материнские платы должны быть одинаковы, чтобы компьютеры хорошо работали вместе. Конечно, не забудьте о RAM и жесткие диски для каждой ноды, а также как минимум об одном оптическом приводе для главного узла.

Установите серверы в стойку. Начинайте снизу, чтобы стойка не была перегружена сверху. Вам понадобится помощь друга - собранные серверы могут быть очень тяжелыми, и ставить их в ячейки, на которых они держатся в стойке, довольно сложно.

Установите свитч Ethernet рядом со стойкой. Стоит сразу же сконфигурировать свитч: установите размер джамбо-кадров 9000 байт, установите статический IP адрес, который вы выбрали на шаге 1 и выключите ненужные протоколы, такие как SMTP.

Установите распределитель питания (PDU, или Power Distribution Unit). В зависимости от того, какую максимальную нагрузку выдают ноды в вашей сети, вам может потребоваться 220 вольт для высокопроизводительного компьютера.

Когда все установлено, переходите к конфигурированию. Linux по факту является основной системой для высокопроизводительных (HPC) кластеров – он не только идеально подходит в качестве окружения для научных вычислений, но вам еще и не придется платить за установку системы на сотни и даже тысячи узлов. Представьте, во сколько обошлась бы установка Windows на все ноды!

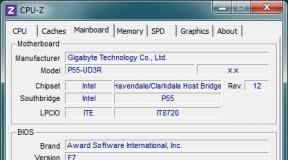

- Начните с установки последней версии BIOS для материнской платы и ПО от производителя, которое должно быть одинаковым для всех серверов.

- Установите предпочитаемый дистрибутив Linux на все ноды, а на главный узел - дистрибутив с графическим интерфейсом. Популярные системы: CentOS, OpenSuse, Scientific Linux, RedHat и SLES.

- Автор очень рекомендует использовать Rocks Cluster Distribution. В дополнение к установке всех необходимых для кластера программ и инструментов, Rocks реализует отличный метод для быстрого "переноса" множества копий системы на аналогичные сервера с использованием PXE boot и процедуры "Kick Start" от Red Hat.

Установите интерфейс передачи сообщений, менеджер ресурсов и другие необходимые библиотеки. Если вы не поставили Rocks на предыдущем шаге, вам придется вручную устанавливать необходимое программное обеспечение, чтобы настроить логику параллельных вычислений.

- Для начала вам понадобится портативная система для работы с bash, например, Torque Resource Manager, который позволяет разделять и распределять задачи на несколько машин.

- Добавьте к Torque еще Maui Cluster Scheduler, чтобы закончить установку.

- Дальше вам нужно установить интерфейс передачи сообщений, который необходим для того, чтобы индивидуальные процессы в каждой отдельной ноде использовали общие данные. OpenMP - самый простой вариант.

- Не забудьте о многопоточных математических библиотеках и компиляторах, которые будут «собирать» ваши программы для распределенных вычислений. Я уже говорил, что вам стоит просто поставить Rocks?

Соедините компьютеры в сеть. Главная нода посылает задачи для вычисления на подчиненные ноды, которые в свою очередь должны вернуть результат обратно, а также отправлять сообщения друг другу. И чем быстрее все это происходит, тем лучше.

- Используйте частную Ethernet сеть, чтобы соединить все ноды в кластер.

- Главная нода может также работать в качестве NFS, PXE, DHCP, TFTP и NTP сервера при подключении к Ethernet.

- Вы должны отделить эту сеть от публичных, чтобы быть уверенным, что пакеты не перекрываются другими в LAN.

Протестируйте кластер. Последнее, что вам стоит сделать перед тем, как дать доступ пользователям к компьютерным мощностям - протестировать производительность. HPL (High Performance Lynpack) benchmark - популярный вариант для измерения скорости вычислений в кластере. Вам нужно скомпилировать ПО из исходников с самой высокой степенью оптимизации, которую позволяет ваш компилятор для той архитектуры, которую вы выбрали.

- Вы должны, конечно, компилировать со всеми возможными настройками оптимизации, которые доступны для платформы, которую вы выбрали. Например, при использовании AMD CPU компилируйте в Open64 и уровнем оптимизации -0.

- Сравните полученные результаты с TOP500.org, чтобы сопоставить свой кластер с 500 самыми быстрыми суперкомпьютерами в мире!

Введение

Кластер серверов – это группа независимых серверов под управлением службы кластеров, работающих совместно как единая система. Кластеры серверов создаются путем объединения нескольких серверов на базе Windows® 2000 Advanced Server и Windows 2000 Datacenter Server для совместной работы, обеспечивая тем самым высокий уровень доступности, масштабируемости и управляемости для ресурсов и приложений.

Задачей кластера серверов является обеспечение непрерывного доступа пользователей к приложениям и ресурсам в случаях аппаратных или программных сбоев или плановых остановках оборудования. Если один из серверов кластера оказывается недоступен по причине сбоя или его остановки для выполнения технического обслуживания, информационные ресурсы и приложения перераспределяются между остальными доступными узлами кластера.

Для кластерных систем использование термина «высокая доступность» является более предпочтительным, чем использование термина «отказоустойчивость» , поскольку технологии обеспечения отказоустойчивости предполагают более высокий уровень стойкости оборудования к внешним воздействиям и механизмов восстановления. Как правило, отказоустойчивые серверы используют высокую степень аппаратной избыточности, плюс в дополнение к этому специализированное программное обеспечение, позволяющее практически незамедлительно восстановить работу в случае любого отдельного сбоя программного или аппаратного обеспечения. Эти решения обходятся существенно дороже по сравнению с использованием кластерных технологий, поскольку организации вынуждены переплачивать за дополнительное аппаратное обеспечение, которое простаивает все основное время, и используется лишь в случае возникновения сбоев. Отказоустойчивые серверы используются для приложений, обслуживающих интенсивный поток дорогостоящих транзакций в таких сферах деятельности, как центры обработки платежных средств, банкоматы или фондовые биржи.

Хотя служба кластеров и не гарантирует безостановочной работы, она предоставляет высокий уровень доступности, достаточный для работы большинства критически важных приложений. Служба кластеров может отслеживать работу приложений и ресурсов, автоматически распознавая состояние сбоев и восстанавливая работу системы после их устранения. Это обеспечивает более гибкое управление рабочей нагрузкой внутри кластера, и повышает доступность системы в целом.

Основные преимущества, получаемые при использовании службы кластеров:

- Высокая доступность. В случае отказа какого-либо узла служба кластеров передает управление ресурсами, такими как, например, жесткие диски и сетевые адреса, действующему узлу кластера. Когда происходит программный или аппаратный сбой, программное обеспечение кластера перезапускает завершившееся с ошибкой приложение на действующем узле, или перемещает всю нагрузку отказавшего узла на оставшиеся действующие узлы. При этом пользователи могут заметить лишь кратковременную задержку в обслуживании.

- Возврат после отказа. Служба кластеров автоматически перераспределяет рабочую нагрузку в кластере, когда отказавший узел вновь становится доступным.

- Управляемость. Администратор кластера – это оснастка, которую Вы можете использовать для управления кластером как единой системой, а также для управления приложениями. Администратор кластера обеспечивает прозрачное представление работы приложений так, как если бы они выполнялись на одном сервере. Вы можете перемещать приложения на различные серверы в пределах кластера, перетаскивая объекты кластера мышью. Таким же образом можно перемещать данные. Этот способ может использоваться для ручного распределения рабочей нагрузки серверов, а также для разгрузки сервера и его последующей остановки с целью проведения планового технического обслуживания. Кроме того, Администратор кластера позволяет удаленно производить наблюдение за состоянием кластера, всех его узлов и ресурсов.

- Масштабируемость. Для того чтобы производительность кластера всегда могла соответствовать возрастающим требованиям, служба кластеров располагает возможностями масштабирования. Если общая производительность кластера становится недостаточной для обработки нагрузки, создаваемой кластерными приложениями, в кластер могут быть добавлены дополнительные узлы.

Этот документ содержит инструкции по установке службы кластеров на серверах, работающих под управлением Windows 2000 Advanced Server и Windows 2000 Datacenter Server, и описывает процесс установки службы кластеров на серверы кластерных узлов. Данное руководство не описывает установку и настройку кластерных приложений, а лишь помогает Вам пройти через весь процесс установки простого двухузлового кластера.

Системные требования для создания кластера серверов

Следующие контрольные списки помогут Вам произвести подготовку к установке. Пошаговые инструкции по установке будут представлены далее после этих списков.

Требования к программному обеспечению

- Операционная система Microsoft Windows 2000 Advanced Server или Windows 2000 Datacenter Server, установленная на всех серверах кластера.

- Установленная служба разрешения имен, такая как Domain Naming System (DNS), Windows Internet Naming System (WINS), HOSTS и т. д.

- Сервер терминалов для удаленного администрирования кластера. Данное требование не является обязательным, а рекомендуется лишь для обеспечения удобства управления кластером.

Требования к аппаратному обеспечению

- Требования, предъявляемые к аппаратному обеспечению узла кластера, аналогичны требованиям для установки операционных систем Windows 2000 Advanced Server или Windows 2000 Datacenter Server. Эти требования можно найти на странице поиска каталога Microsoft.

- Оборудование кластера должно быть сертифицировано и указано в списке совместимого аппаратного обеспечения (HCL) каталога Microsoft для службы кластеров. Последнюю версию этого списка можно на странице поиска Windows 2000 Hardware Compatibility List каталога Microsoft, выбрав категорию поиска «Cluster».

Два компьютера, удовлетворяющих требованиям списка HCL, каждый из которых имеет:

- Жесткий диск с загрузочным системным разделом и установленной операционной системой Windows 2000 Advanced Server или Windows 2000 Datacenter Server. Этот диск не должен быть подключен к шине общего запоминающего устройства, рассмотренного ниже.

- Отдельный PCI-контроллер устройств оптического канала (Fibre Channel) или SCSI для подключения внешнего общего запоминающего устройства. Этот контроллер должен присутствовать в дополнение к контроллеру загрузочного диска.

- Два сетевых PCI адаптера, установленных на каждом компьютере кластера.

- Перечисленное в списке HCL внешнее дисковое запоминающее устройство, подключенное ко всем узлам кластера. Оно будет выступать в качестве диска кластера. Рекомендуется конфигурация с использованием аппаратных RAID-массивов.

- Кабели для подключения общего запоминающего устройства ко всем компьютерам. Для получения инструкций по конфигурированию запоминающих устройств обратитесь к документации производителя. Если подключение производится к шине SCSI, Вы можете обратиться к приложению А для дополнительной информации.

- Все оборудование на компьютерах кластера должно быть полностью идентичным. Это упростит процесс конфигурирования и избавит Вас от потенциальных проблем с совместимостью.

Требования к настройке сетевой конфигурации

- Уникальное NetBIOS имя для кластера.

- Пять уникальных статических IP-адресов: два адреса для сетевых адаптеров частной сети, два – для сетевых адаптеров публичной сети, и один адрес для кластера.

- Доменная учетная запись для службы кластеров (все узлы кластера должны быть членами одного домена)

- Каждый узел должен иметь два сетевых адаптера – один для подключения к публичной сети, один – для внутрикластерного взаимодействия узлов. Конфигурация с использованием одного сетевого адаптера для одновременного подключения к публичной и частной сети не поддерживается. Наличие отдельного сетевого адаптера для частной сети необходимо для соответствия требованиям HCL.

Требования к дискам общего запоминающего устройства

- Все диски общего запоминающего устройства, включая диск кворума, должны быть физически подключены к общей шине.

- Все диски, подключенные к общей шине, должны быть доступны для каждого узла. Это можно проверить на этапе установки и конфигурирования хост-адаптера. Для подробных инструкций обратитесь к документации производителя адаптера.

- Устройствам SCSI должны быть назначены целевые уникальные номера SCSI ID, кроме этого на шине SCSI должны быть правильно установлены терминаторы, в соответствии с инструкциями производителя. 1

- Все диски общего запоминающего устройства должны быть настроены как базовые диски (не динамические)

- Все разделы дисков общего запоминающего устройства должны быть отформатированы в файловой системе NTFS.

Крайне рекомендуется объединять все диски общего запоминающего устройства в аппаратные RAID-массивы. Хотя это и не является обязательным, создание отказоустойчивых конфигураций RAID является ключевым моментом в обеспечении защиты от дисковых сбоев.

Установка кластера

Общий обзор установки

Во время процесса установки некоторые узлы будут выключены, а некоторые перезагружены. Это необходимо для того, чтобы обеспечить целостность данных, расположенных на дисках, подключенных к общей шине внешнего запоминающего устройства. Повреждение данных может произойти в тот момент, когда несколько узлов одновременно попытаются произвести запись на один и тот же диск, не защищенный программным обеспечением кластера.

Таблица 1 поможет Вам определить, какие узлы и запоминающие устройства должны быть включены на каждом этапе установки.

Это руководство описывает создание двухузлового кластера. Тем не менее, если Вы устанавливаете кластер с более чем двумя узлами, Вы можете использовать значение столбца «Узел 2» для определения состояния остальных узлов.

Таблица 1. Последовательность включения устройств при установке кластера

| Шаг | Узел 1 | Узел 2 | Устройство хранения | Комментарий |

| Установка параметров сети | Вкл. | Вкл. | Выкл. | Убедитесь, что все устройства хранения, подключенные к общей шине, выключены. Включите все узлы. |

| Настройка общих дисков | Вкл. | Выкл. | Вкл. | Выключите все узлы. Включите общее запоминающее устройство, затем включите первый узел. |

| Проверка конфигурации общих дисков | Выкл. | Вкл. | Вкл. | Выключите первый узел, включите второй узел. При необходимости повторите для узлов 3 и 4. |

| Конфигурирование первого узла | Вкл. | Выкл. | Вкл. | Выключите все узлы; включите первый узел. |

| Конфигурирование второго узла | Вкл. | Вкл. | Вкл. | После успешной конфигурации первого узла включите второй узел. При необходимости повторите для узлов 3 и 4. |

| Завершение установки | Вкл. | Вкл. | Вкл. | К этому моменту все узлы должны быть включены. |

Перед установкой программного обеспечения кластеров необходимо выполнить следующие шаги:

- Установить на каждый компьютер кластера операционную систему Windows 2000 Advanced Server или Windows 2000 Datacenter Server.

- Настроить сетевые параметры.

- Настроить диски общего запоминающего устройства.

Выполните эти шаги на каждом узле кластера прежде, чем приступать к установке службы кластеров на первом узле.

Для конфигурирования службы кластеров на сервере под управлением Windows 2000 Ваша учетная запись должна иметь права администратора на каждом узле. Все узлы кластера должны быть одновременно либо рядовыми серверами, либо контроллерами одного и того же домена. Смешанное использование рядовых серверов и контроллеров домена в кластере недопустимо.

Установка операционной системы Windows 2000

Для установки Windows 2000 на каждом узле кластера обратитесь к документации, которую Вы получили в комплекте с операционной системой.

В этом документе используется структура имен из руководства "Step-by-Step Guide to a Common Infrastructure for Windows 2000 Server Deployment" . Однако, Вы можете использовать любые имена.

Прежде, чем начинать установку службы кластеров, Вы должны выполнить вход систему под учетной записью администратора

Настройка сетевых параметров

Примечание: На этом этапе установки выключите все общие запоминающие устройства, а затем включите все узлы. Вы должны исключить возможность одновременного доступа нескольких узлов к общему запоминающему устройству до того момента, когда служба кластеров будет установлена, по крайней мере, на одном из узлов, и этот узел будет включен.

На каждом узле должно быть установлено как минимум два сетевых адаптера – один для подключения к публичной сети, и один для подключения к частной сети, состоящей из узлов кластера.

Сетевой адаптер частной сети обеспечивает взаимодействие между узлами, передачу сведений о текущем состоянии кластера и управление кластером. Сетевой адаптер публичной сети каждого узла соединяет кластер с публичной сетью, состоящей из клиентских компьютеров.

Убедитесь, что все сетевые адаптеры правильно подключены физически: адаптеры частной сети подключены только к другим адаптерам частной сети, и адаптеры публичной сети подключены к коммутаторам публичной сети. Схема подключения изображена на Рисунке 1. Выполните такую проверку на каждом узле кластера, прежде чем переходить к настройке дисков общего запоминающего устройства.

Рисунок 1: Пример двухузлового кластера

Конфигурирование сетевого адаптера частной сети

Выполните эти шаги на первом узле Вашего кластера.

- Мое сетевое окружение и выберите команду Свойства .

- Щелкните правой кнопкой мыши на значке .

Примечание: Какой сетевой адаптер будет обслуживать частную сеть, а какой публичную, зависит от физического подключения сетевых кабелей. В данном документе мы будем предполагать, что первый адаптер (Подключение по локальной сети) подключен к публичной сети, а второй адаптер (Подключение по локальной сети 2) подключен к частной сети кластера. В Вашем случае это может быть не так.

- Состояние. Окно Состояние Подключение по локальной сети 2 показывает состояние подключения и его скорость. Если подключение находится в отключенном состоянии, проверьте кабели и правильность соединения. Устраните проблему, прежде чем продолжить. Нажмите кнопку Закрыть .

- Снова щелкните правой кнопкой мыши на значке Подключение по локальной сети 2 , выберите команду Свойства и нажмите кнопку Настроить .

- Выберите вкладку Дополнительно. Появится окно, изображенное на Рисунке 2.

- Для сетевых адаптеров частной сети скорость работы должна быть выставлена вручную вместо значения, используемого по умолчанию. Укажите скорость Вашей сети в раскрывающемся списке. Не используйте значения «Auto Sense» или «Auto Select» для выбора скорости, поскольку некоторые сетевые адаптеры могут сбрасывать пакеты во время определения скорости соединения. Для задания скорости сетевого адаптера укажите фактическое значение для параметра Тип подключения или Скорость .

Рисунок 2: Дополнительные настройки сетевого адаптера

Все сетевые адаптеры кластера, подключенные к одной сети, должны быть одинаково настроены и использовать одинаковые значения параметров Дуплексный режим , Управление потоком , Тип подключения , и т. д. Даже если на разных узлах используется различное сетевое оборудование, значения этих параметров должны быть одинаковыми.

- Выберите Протокол Интернета (TCP/IP) в списке компонентов, используемых подключением.

- Нажмите кнопку Свойства .

- Установите переключатель в положение Использовать следующий IP-адрес и введите адрес 10.1.1.1 . (Для второго узла используйте адрес 10.1.1.2 ).

- Задайте маску подсети: 255.0.0.0 .

- Нажмите кнопку Дополнительно и выберите вкладку WINS. Установите значение переключателя в положение Отключить NetBIOS через TCP/IP . Нажмите OK для возврата в предыдущее меню. Выполняйте этот шаг только для адаптера частной сети.

Ваше диалоговое окно должно выглядеть, как изображено на Рисунке 3.

Рисунок 3: IP-адрес подключения к частной сети

Конфигурирование сетевого адаптера публичной сети

Примечание: Если в публичной сети работает DHCP-сервер, IP-адрес для сетевого адаптера публичной сети может назначаться автоматически. Однако для адаптеров узлов кластера этот способ использовать не рекомендуется. Мы настоятельно рекомендуем назначать постоянные IP-адреса для всех публичных и частных сетевых адаптеров узлов. В противном случае при отказе DHCP-сервера доступ к узлам кластера может оказаться невозможным. Если же Вы вынуждены использовать DHCP для сетевых адаптеров публичной сети, используйте длительные сроки аренды адресов – это даст гарантию того, что динамически назначенный адрес останется действительным, даже если DHCP-сервер окажется временно недоступным. Адаптерам частной сети всегда назначайте постоянные IP-адреса. Помните, что служба кластеров может распознавать только один сетевой интерфейс в каждой подсети. Если Вам нужна помощь в вопросах назначения сетевых адресов в Windows 2000, обратитесь к встроенной справке операционной системы.

Переименование сетевых подключений

Для ясности мы рекомендуем изменить названия сетевых подключений. Например, Вы можете изменить название подключения Подключение по локальной сети 2 на . Такой метод поможет Вам проще идентифицировать сети и правильно назначать их роли.

- Щелкните правой кнопкой мыши на значке 2.

- В контекстном меню выберите команду Переименовать .

- Введите Подключение к частной сети кластера в текстовом поле и нажмите клавишу ВВОД .

- Повторите шаги 1-3 и измените название подключения Подключение по локальной сети на Подключение к публичной сети.

Рисунок 4: Переименованные сетевые подключения

- Переименованные сетевые подключения должны выглядеть, как показано на Рисунке 4. Закройте окно Сеть и удаленный доступ к сети . Новые названия сетевых подключений автоматически реплицируются на другие узлы кластера при их включении.

Проверка сетевых соединений и разрешений имен

Для проверки работы настроенного сетевого оборудования, выполните следующие шаги для всех сетевых адаптеров каждого узла. Для этого Вы должны знать IP-адреса всех сетевых адаптеров в кластере. Вы можете получить эту информацию, выполнив команду ipconfig на каждом узле:

- Нажмите кнопку Пуск, выберите команду Выполнить и наберите команду cmd в текстовом окне. Нажмите OK .

- Наберите команду ipconfig /all и нажмите клавишу ВВОД . Вы увидите информацию о настройке IP-протокола для каждого сетевого адаптера на локальной машине.

- В случае, если у Вас еще не открыто окно командной строки, выполните шаг 1.

- Наберите команду ping ipaddress где ipaddress – это IP-адрес соответствующего сетевого адаптера на другом узле. Предположим для примера, что сетевые адаптеры имеют следующие IP-адреса:

| Номер узла | Имя сетевого подключения | IP-адрес сетевого адаптера |

| 1 | Подключение к публичной сети | 172.16.12.12 |

| 1 | Подключение к частной сети кластера | 10.1.1.1 |

| 2 | Подключение к публичной сети | 172.16.12.14 |

| 2 | Подключение к частной сети кластера | 10.1.1.2 |

В этом примере Вам нужно выполнить команды ping 172.16.12.14 и ping 10.1.1.2 с узла 1, и выполнить команды ping 172.16.12.12 и ping 10.1.1.1 с узла 2.

Чтобы проверить разрешение имен, выполните команду ping , используя в качестве аргумента имя компьютера вместо его IP-адреса. Например, чтобы проверить разрешение имени для первого узла кластера с именем hq-res-dc01, выполните команду ping hq-res-dc01 с любого клиентского компьютера.

Проверка принадлежности к домену

Все узлы кластера должны являться членами одного домена и иметь возможности сетевого взаимодействия с контроллером домена и DNS-сервером. Узлы могут быть сконфигурированы как рядовые сервера домена или как контроллеры одного и того же домена. Если Вы решите сделать один из узлов контроллером домена, то все остальные узлы кластера также должны быть сконфигурированы как контроллеры этого же домена. В этом руководстве предполагается, что все узлы являются контроллерами домена.

Примечание: Для получения ссылок на дополнительную документацию по настройке доменов, служб DNS и DHCP в Windows 2000 смотрите раздел Связанные ресурсы в конце этого документа.

- Щелкните правой кнопкой мыши Мой компьютер и выберите команду Свойства .

- Выберите вкладку Сетевая идентификация . В диалоговом окне Свойства системы Вы увидите полное имя компьютера и домена. В нашем примере домен называется reskit.com .

- Если Вы сконфигурировали узел в качестве рядового сервера, то на этом этапе Вы можете присоединить его к домену. Нажмите кнопку Свойства и следуйте инструкциям для присоединения компьютера к домену.

- Закройте окна Свойства системы и Мой компьютер .

Создание учетной записи службы кластеров

Для службы кластеров необходимо создать отдельную доменную учетную запись, от имени которой она будет запускаться. Программа установки потребует ввода учетных данных для службы кластеров, поэтому учетная запись должна быть создана до начала установки службы. Учетная запись не должна принадлежать какому-либо пользователю домена, и должна использоваться исключительно для работы службы кластеров.

- Нажмите кнопку Пуск , выберите команду Программы / Администрирование , запустите оснастку .

- Разверните категорию reskit.com , если она еще не развернута

- В списке выберите Users .

- Щелкните правой кнопкой мыши на Users , выберите в контекстном меню Создать , выберите Пользователь .

- Введите имя для учетной записи службы кластера, как показано на Рисунке 5, и нажмите кнопку Далее.

Рисунок 5: Добавление пользователя Cluster

- Установите флажки Запретить смену пароля пользователем и Срок действия пароля не ограничен . Нажмите кнопку Далее и кнопку Готово , чтобы создать пользователя.

Примечание: Если Ваша административная политика безопасности не позволяет использовать пароли с неограниченным сроком действия, Вы должны будете обновить пароль и произвести конфигурацию службы кластеров на каждом узле до истечения срока его действия.

- Щелкните правой клавишей мыши на пользователе Cluster в правой панели оснастки Active Directory – пользователи и компьютеры .

- В контекстном меню выберите команду Добавить участников в группу .

- Выберите группу Администраторы и нажмите OK . Теперь новая учетная запись имеет привилегии администратора на локальном компьютере.

- Закройте оснастку Active Directory – пользователи и компьютеры .

Настройка дисков общего запоминающего устройства

Предупреждение: Убедитесь, что, по крайней мере, на одном из узлов кластера установлена операционная система Windows 2000 Advanced Server или Windows 2000 Datacenter Server, а также настроена и работает служба кластеров. Только после этого можно загружать операционную систему Windows 2000 на остальных узлах. Если эти условия не будут выполнены, диски кластера могут быть повреждены.

Чтобы приступить к настройке дисков общего запоминающего устройства, выключите все узлы. После этого включите общее запоминающее устройство, затем включите узел 1.

Диск кворума

Диск кворума используется для хранения контрольных точек и файлов журнала восстановления базы данных кластера, обеспечивая управление кластером. Мы даем следующие рекомендации для создания диска кворума:

- Создайте небольшой раздел (размером как минимум 50 Мб), чтобы использовать его в качестве диска кворума. Обычно мы рекомендуем создавать диск кворума размером в 500 Мб.

- Выделите отдельный диск для ресурса кворума. Поскольку в случае выхода из строя диска кворума произойдет сбой работы всего кластера, мы настоятельно рекомендуем использовать аппаратный дисковый RAID-массив.

В процессе установки службы кластеров Вы будете должны назначить букву диску кворума. В нашем примере мы будем использовать букву Q .

Конфигурирование дисков общего запоминающего устройства

- Щелкните правой кнопкой мыши Мой компьютер , выберите команду Управление . В открывшемся окне раскройте категорию Запоминающие устройства .

- Выберите команду Управление дисками .

- Убедитесь, что все диски общего запоминающего устройства отформатированы в системе NTFS и имеют статус Основной . Если Вы подключите новый диск, автоматически запустится Мастер подписывания и обновления дисков . Когда мастер запустится, нажмите кнопку Обновить, чтобы продолжить его работу, после этого диск будет определен как Динамический . Чтобы преобразовать диск в базовый, щелкните правой кнопкой мыши на Диск # (где # – номер диска, с которым Вы работаете) и выберите команду Возвратить к базовому диску .

Щелкните правой кнопкой мыши область Не распределен рядом с соответствующим диском.

- Выберите команду Создать раздел

- Запустится Мастер создания раздела . Дважды нажмите кнопку Далее .

- Введите желаемый размер раздела в мегабайтах и нажмите кнопку Далее .

- Нажмите кнопку Далее , приняв предложенную по умолчанию букву диска

- Нажмите кнопку Далее для форматирования и создания раздела.

Назначение букв дискам

После того, как шина данных, диски и разделы общего запоминающего устройства сконфигурированы, необходимо назначить буквы диска для всех разделов всех дисков кластера.

Примечание: Точки подключения – это функциональная возможность файловой системы, которая позволяет Вам устанавливать файловую систему, используя существующие каталоги, без назначения буквы диска. Точки подключения не поддерживаются кластерами. Любой внешний диск, используемый в качестве ресурса кластера, должен быть разбит на NTFS разделы, и этим разделам должны быть назначены буквы диска.

- Щелкните правой кнопкой мыши требуемый раздел и выберите команду Изменение буквы диска и пути диска .

- Выберите новую букву диска.

- Повторите шаги 1 и 2 для всех дисков общего запоминающего устройства.

Рисунок 6: Разделы дисков с назначенными буквами

- По окончании процедуры окно оснастки Управление компьютером должно выглядеть, как изображено на Рисунке 6. Закройте оснастку Управление компьютером .

- Нажмите кнопку Пуск , выберите Программы / Стандартные , и запустите программу «Блокнот» .

- Наберите несколько слов и сохраните файл под именем test.txt , выбрав команду Сохранить как из меню Файл . Закройте Блокнот .

- Дважды щелкните мышью на значке Мои документы .

- Щелкните правой кнопкой мыши на файле test.txt и в контекстном меню выберите команду Копировать .

- Закройте окно.

- Откройте Мой компьютер .

- Дважды щелкните мышью на разделе диска общего запоминающего устройства.

- Щелкните правой кнопкой мыши и выберите команду Вставить .

- На диске общего запоминающего устройства должна появиться копия файла test.txt .

- Дважды щелкните мышью на файле test.txt , чтобы открыть его с диска общего запоминающего устройства. Закройте файл.

- Выделите файл и нажмите клавишу Del , чтобы удалить файл с диска кластера.

Повторите процедуру для всех дисков кластера, чтобы убедиться, что они доступны с первого узла.

Теперь выключите первый узел, включите второй узел и повторите шаги раздела Проверка работы и общего доступа к дискам . Выполните эти же шаги на всех дополнительных узлах. После того, как Вы убедитесь, что все узлы могут считывать и записывать информацию на диски общего запоминающего устройства, выключите все узлы, кроме первого, и переходите к следующему разделу.